Boję się. Bardzo przestraszony.

Nadchodzi ogólnoświatowy nadzór i cenzura, możliwe dzięki niewyobrażalnie ogromnej mocy obliczeniowej sztucznej inteligencji (AI).

To nie jest futurystyczna dystopia. To się dzieje teraz.

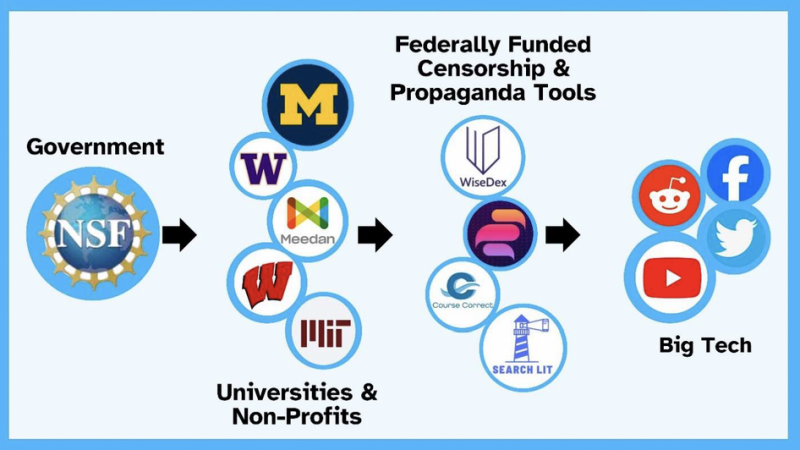

Agencje rządowe współpracują z uniwersytetami i organizacjami non-profit nad wykorzystaniem narzędzi sztucznej inteligencji do monitorowania i cenzurowania treści w Internecie.

To nie jest kwestia polityczna ani partyzancka. Tu nie chodzi o jakąś konkretną opinię czy pomysł.

Dzieje się tak, że rząd staje się dostępny dla narzędzia wystarczająco potężnego, aby monitorować wszystko, co się mówi i robi w Internecie (lub jego dużą część), w celu ciągłego monitorowania nas wszystkich. Na podstawie tego monitorowania rząd – oraz każda organizacja lub firma, z którą rząd współpracuje – może następnie użyć tego samego narzędzia do tłumienia, wyciszania i zamykania wypowiedzi, które im się nie podobają.

Ale to nie wszystko. Korzystając z tego samego narzędzia, rząd i jego publiczno-prywatni, „pozarządowi” partnerzy (np. Światowa Organizacja Zdrowia lub Monsanto) mogą również zablokować wszelką działalność powiązaną z Internetem. Bankowość, kupno, sprzedaż, nauczanie, uczenie się, rozrywka, łączenie się ze sobą – jeśli kontrolowanej przez rząd sztucznej inteligencji nie spodoba się to, co Ty (lub Twoje dzieci!) powiesz w tweecie lub e-mailu, może to wszystko zamknąć na jakiś czas Ty.

Tak, widzieliśmy to na bardzo lokalną i upolitycznioną skalę, na przykład kanadyjskich kierowców ciężarówek.

Jeśli jednak myśleliśmy, że tego typu działania nie mogą lub nie mogą mieć miejsca na skalę krajową (lub nawet bardziej przerażającą – globalną), musimy się obudzić już teraz i zdać sobie sprawę, że to się dzieje i być może nie da się tego zatrzymać.

Nowe dokumenty pokazują, że finansowana przez rząd sztuczna inteligencja jest przeznaczona do cenzury w Internecie

Podkomisja Specjalna Izby Reprezentantów Stanów Zjednoczonych ds. Uzbrojenia Rządu Federalnego została utworzona w styczniu 2023 r. „w celu zbadania kwestii związanych z gromadzeniem, analizą, rozpowszechnianiem i wykorzystywaniem informacji o obywatelach USA przez agencje władzy wykonawczej, w tym czy takie wysiłki są nielegalne, niezgodne z konstytucją lub w inny sposób nieetyczne”.

Niestety, nawet przez jej członków praca komisji jest postrzegana jako w dużej mierze polityczna: konserwatywni prawodawcy badają, co ich zdaniem oznacza wyciszanie głosów konserwatywnych przez agencje rządowe o poglądach liberalnych.

Niemniej jednak w trakcie swoich dochodzeń komisja ta odkryła kilka zdumiewających dokumentów związanych z próbami rządu cenzurowania wypowiedzi obywateli amerykańskich.

Dokumenty te mają kluczowe i przerażające implikacje dla całego społeczeństwa.

W raporcie okresowym Podkomisji pt. z 5 lutego 2024 rz dokumentów wynika, że grupy akademickie i organizacje non-profit namawiają agencję rządową do opracowania planu wykorzystania „usług dezinformacyjnych” sztucznej inteligencji do cenzurowania treści na platformach internetowych.

W szczególności Uniwersytet Michigan wyjaśnia Narodowej Fundacji Nauki (NSF), że narzędzia oparte na sztucznej inteligencji finansowane przez NSF można wykorzystać, aby pomóc platformom mediów społecznościowych w przeprowadzaniu działań cenzuralnych bez konieczności podejmowania faktycznych decyzji o tym, co powinno zostać ocenzurowane.

Oto jak tę zależność przedstawiono w raporcie Podkomisji:

Oto konkretny cytat przedstawiony w raporcie Podkomisji. Pochodzi z „notatek prelegenta z pierwszej rozmowy Uniwersytetu Michigan skierowanej do National Science Foundation (NSF) na temat finansowanego przez NSF i opartego na sztucznej inteligencji narzędzia WiseDex”. Notatki znajdują się w aktach komisji.

Nasza usługa dezinformacji pomaga decydentom na platformach, którzy chcą… zrzucić odpowiedzialność za trudne oceny na osobę spoza firmy… poprzez uzewnętrznienie trudnej odpowiedzialności cenzury.

To niezwykłe stwierdzenie na wielu poziomach:

- Wyraźnie utożsamia „usługi dezinformacyjne” z cenzurą.

Jest to kluczowe równanie, ponieważ rządy na całym świecie udają, że zwalczają szkodliwą dezinformację, podczas gdy w rzeczywistości tak jest uchwalanie masowych ustaw cenzuralnych, Ogłoszono WEF „dezinformacja i dezinformacja” to „najpoważniejsze globalne ryzyko” w ciągu najbliższych dwóch lat, co prawdopodobnie oznacza, że ich największe wysiłki zostaną skierowane na cenzurę.

Kiedy wykonawca rządowy wyraźnie stwierdza, że sprzedaje „usługę dezinformacyjną”, która pomaga platformom internetowym „uzewnętrzniać cenzurę” – uznaje się, że te dwa terminy są zamienne.

- Odnosi się do cenzury jako do „obowiązku”.

Innymi słowy, zakłada, że częścią tego, czym platformy powinny się zajmować, jest cenzura. Brak ochrony dzieci przed drapieżnikami seksualnymi lub niewinnych obywateli przed dezinformacją – po prostu zwykła, nieskazitelna cenzura.

- Stwierdza, że rolą AI jest „uzewnętrznianie” odpowiedzialności za cenzurę.

Platformy technologiczne nie chcą podejmować cenzuralnych decyzji. Rząd chce podejmować takie decyzje, ale nie chce, aby postrzegano go jako cenzurę. Narzędzia sztucznej inteligencji pozwalają platformom „uzewnętrzniać” decyzje dotyczące cenzury, a rządowi ukrywać swoje działania cenzuralne.

Wszystko to powinno położyć kres złudzeniu, że to, co rządy na całym świecie nazywają „przeciwdziałaniem dezinformacji i mowie nienawiści”, nie jest zwykłą cenzurą.

Co się stanie, gdy cenzura AI zostanie w pełni wdrożona?

Wiedząc, że rząd już płaci za narzędzia cenzury AI, musimy zastanowić się, co to oznacza.

Brak limitów siły roboczej: Jak wskazuje raport Podkomisji, ograniczenia rządowej cenzury w Internecie do tej pory wiązały się z dużą liczbą ludzi wymaganych do przeglądania niekończących się plików i podejmowania decyzji dotyczących cenzury. W przypadku sztucznej inteligencji nie trzeba angażować prawie żadnego człowieka, a ilość danych, które można nadzorować, może być tak ogromna, jak wszystko, co ktoś powie na określonej platformie. Taka ilość danych jest niezrozumiała dla pojedynczego ludzkiego mózgu.

Nikt nie jest odpowiedzialny: Jednym z najbardziej przerażających aspektów cenzury sztucznej inteligencji jest to, że gdy robi to sztuczna inteligencja, żadna osoba ani organizacja – czy to rząd, platformy czy uniwersytet/organizacje non-profit – nie jest faktycznie odpowiedzialna za cenzurę. Początkowo ludzie przekazują do narzędzia AI instrukcje dotyczące kategorii lub typów języka, które należy cenzurować, ale potem maszyna idzie dalej i sama podejmuje indywidualne decyzje w każdym przypadku.

Brak możliwości zgłaszania skarg: Gdy sztuczna inteligencja zostanie uwolniona za pomocą zestawu instrukcji cenzury, zmiata miliardy punktów danych online i zastosuje działania cenzury. Jeśli chcesz zakwestionować akcję cenzury AI, będziesz musiał porozmawiać z maszyną. Być może platformy będą zatrudniać ludzi do odpowiadania na apele. Ale po co mieliby to robić, skoro mają sztuczną inteligencję, która może zautomatyzować te reakcje?

Brak ochrony dla młodych ludzi: Jednym z twierdzeń cenzorów rządowych jest to, że musimy chronić nasze dzieci przed szkodliwymi informacjami w Internecie, takimi jak treści, które powodują anoreksję, zachęcają do samobójstwa, zamieniają je w terrorystów ISIS i tak dalej. Również z wykorzystywania seksualnego. To wszystko są poważne problemy, które zasługują na uwagę. Ale dla ogromnej liczby młodych ludzi nie są one tak niebezpieczne jak cenzura sztucznej inteligencji.

Niebezpieczeństwo, jakie stwarza cenzura sztucznej inteligencji, dotyczy wszystkich młodych ludzi, którzy spędzają dużo czasu w Internecie, ponieważ oznacza to, że ich działania i język w Internecie mogą być monitorowane i wykorzystywane przeciwko nim – może nie teraz, ale zawsze, gdy rząd zdecyduje się zastosować określony typ języka lub zachowania. Jest to zagrożenie o wiele większe dla znacznie większej liczby dzieci niż zagrożenie, jakie stwarzają jakiekolwiek konkretne treści, gdyż obejmuje całą aktywność, jaką wykonują one w Internecie, dotykającą niemal każdego aspektu ich życia.

Oto przykład ilustrujący to niebezpieczeństwo: Załóżmy, że Twój nastolatek gra w wiele interaktywnych gier wideo online. Załóżmy, że faworyzuje gry zaprojektowane przez chińskie firmy. Być może obserwuje też, jak inni grają w te gry i uczestniczy w czatach i grupach dyskusyjnych na temat tych gier, w których uczestniczy również wielu obywateli Chin.

W przyszłym miesiącu lub przyszłym roku rząd może zdecydować, że każdy, kto mocno angażuje się w gry wideo zaprojektowane w Chinach, stanowi zagrożenie dla demokracji. Może to skutkować zamknięciem kont Twojego syna w mediach społecznościowych lub odmową dostępu do narzędzi finansowych, takich jak pożyczki na studia. Może to również obejmować oznaczanie go na stronach internetowych z ofertami pracy lub randkowymi jako niebezpiecznych lub niepożądanych. Może to oznaczać odmowę wydania paszportu lub umieszczenie go na liście obserwowanych.

Życie Twojego nastolatka właśnie stało się o wiele trudniejsze. Znacznie trudniejsze, niż gdyby zobaczył film rekrutacyjny ISIS lub post na TikToku wychwalający samobójstwo. I działoby się to na znacznie większą skalę niż np wykorzystywania seksualnego, którego używają cenzorzy jako konia trojańskiego mającego na celu normalizację idei cenzury rządowej w Internecie.

Usługi cenzury umożliwiające zarabianie: Narzędzie AI będące własnością rządu może teoretycznie być wykorzystywane przez podmiot pozarządowy za zgodą rządu i za zgodą platform, które chcą „uzewnętrznić” „odpowiedzialność” za cenzurę. Tak więc, choć rząd może wykorzystywać sztuczną inteligencję do monitorowania i tłumienia, powiedzmy na przykład, nastrojów antywojennych, firma mogłaby wykorzystać ją do monitorowania i tłumienia, powiedzmy na przykład, nastrojów przeciwko fast foodom. Rząd mógłby zarobić dużo pieniędzy, sprzedając usługi narzędzi AI stronom trzecim. Platformy mogłyby również poprosić o cięcie. Zatem narzędzia cenzury AI mogą potencjalnie przynieść korzyści rządowi, platformom technologicznym i prywatnym korporacjom. Zachęty są tak potężne, że prawie niemożliwe jest wyobrażenie sobie, że nie zostaną wykorzystane.

Czy możemy odwrócić kurs?

Nie wiem, ile agencji rządowych i ile platform korzysta z narzędzi cenzury AI. Nie wiem, jak szybko uda im się zwiększyć skalę.

Nie wiem, jakimi narzędziami mamy do dyspozycji – poza podnoszeniem świadomości i próbami lobbowania wśród polityków i wnoszenia pozwów, aby zapobiec cenzurze rządowej i uregulować wykorzystanie narzędzi AI w Internecie.

Jeśli ktoś ma jeszcze jakieś pomysły, to teraz jest czas na ich realizację.

Opublikowane pod a Creative Commons Uznanie autorstwa 4.0 Licencja międzynarodowa

W przypadku przedruków ustaw link kanoniczny z powrotem na oryginał Instytut Brownstone Artykuł i autor.